當「準確率」成為治理盲區

在彼得的實務經驗中,一個反覆出現的場景是這樣的:高層拿到一份 AI 系統評估報告,看到「準確率 94%」,點頭核准上線。幾個月後,模型在特定族群上的誤判引發了法律爭議,或者一次看似無害的資料輸入讓系統做出了完全相反的決策。

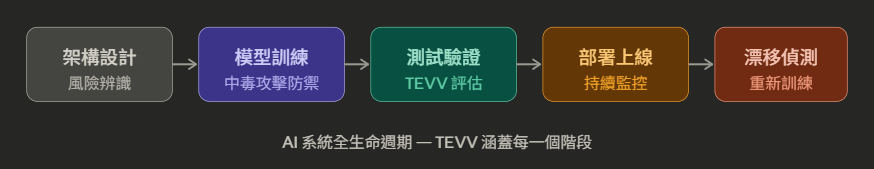

這不是技術失誤,而是治理視野的缺口。AI TEVV(測試、評估、驗證與確認)框架的價值,正是在於把這些隱形風險轉化為可量化、可稽核的管理指標。以下是彼得從框架實務應用中提煉出的五個關鍵觀察。

觀察一:對抗性攻擊不是駭客問題,是模型結構問題

彼得碰到許多客戶面對AI資安時,最常遇到的誤解是:把 AI 的對抗性攻擊當成傳統滲透測試來處理。這個思維框架根本上就錯了。

傳統資安攻擊針對的是程式碼邏輯漏洞;而對抗性攻擊針對的是模型的「統計流形」——也就是神經網路在高維空間中理解世界的方式本身。逃避攻擊(Evasion Attacks)在輸入中加入人眼不可見的微小擾動,就能讓模型做出完全錯誤的判斷;中毒攻擊(Poisoning Attacks)則在訓練階段就植入惡意邏輯,等到模型部署後才發作。

這意味著彼得向治理管理人員介紹時都會強調:現有的程式碼掃描工具、弱點掃描器,對這類攻擊完全視而不見。組織需要的是針對模型穩健性(Robustness)的專屬評估方法。框架給出的量化標準很明確——面對擾動係數 ε < 0.1 的逃避攻擊,系統成功率應低於 5%;在中毒攻擊測試下,準確率下降需控制在 2% 以內。這些數字不是建議值,而是合規的底線。

觀察二:可解釋性與隱私之間存在一個真實的張力

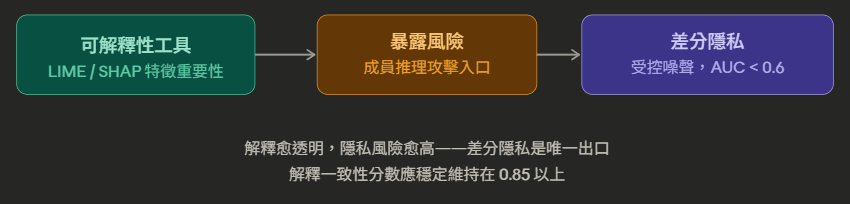

「讓 AI 說明它為何做出這個決策」聽起來很合理,但彼得的實務經驗告訴我們,過度的解釋本身會製造新的風險。

當你使用 LIME 或 SHAP 這類工具,將模型的決策邏輯轉化為「特徵重要性分數」時,你同時也在暗示——哪些訓練資料對模型影響最大。這就打開了成員推理攻擊(Membership Inference Attack)的缺口:攻擊者可以透過系統性地查詢模型輸出,反向推斷出哪些個人資料曾出現在訓練集中。

解方是差分隱私(Differential Privacy)——在訓練過程中刻意加入受控的數學噪聲,使得單一資料點的影響力被稀釋,讓推斷變得不可能。框架要求隱私預算 ε 的嚴格管控,且成員推理攻擊的 AUC 值需低於 0.6。治理層需要理解這個數字的意涵:AUC 為 0.5 代表完全隨機猜測,0.6 已經是彼得認為相當接近安全邊界的臨界點。

觀察三:「優雅地失敗」比「永不失敗」更重要

彼得認為,這是整個 TEVV 框架中最難向非技術背景的治理層解釋的概念,卻也是最關鍵的一個。

很多組織對 AI 系統的期待是「盡可能準確」,卻沒有認真思考「當系統不確定時,它應該怎麼做」。這就是信心校準(Confidence Calibration)的核心問題。一個校準不良的模型,面對從未見過的異常輸入,仍會給出高信心的錯誤答案——這在醫療診斷或金融風控場景中,後果可能是災難性的。

TEVV 框架定義了三種安全失敗模式,彼得在每次系統設計審查時都會逐一確認是否已落地實作:一是主動回傳低信心分數,讓下游系統知道這個輸出不穩定;二是拒絕處理超出專業範疇的請求,而非強行推論;三是觸發人為介入機制,確保在關鍵邊界狀態下,人類始終握有最終決策權。第三點尤其重要——「人類在循環中(Human in the Loop)」不能只是文件上的一句話,必須是系統設計中的強制路徑。

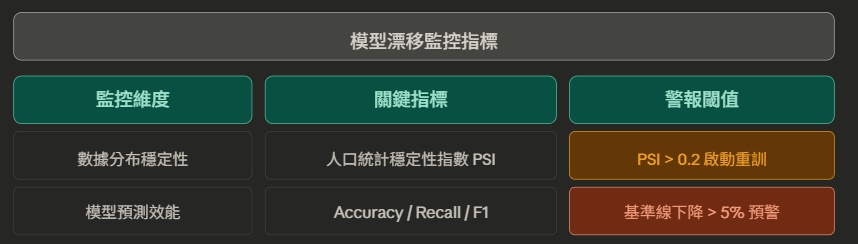

觀察四:模型漂移是一種慢性病,不是突發事件

在彼得接觸過的組織中,大多數的 AI 監控系統只盯著一件事:準確率有沒有掉。這個思維的問題在於,準確率往往是最後一個跌落的指標,在它跌之前,早已有其他訊號在預警。

框架區分了兩種漂移類型,彼得在實務中更害怕的是後者——概念漂移(Concept Drift)。數據漂移是輸入分布改變,相對容易用統計方法偵測;但概念漂移是「特徵與預測目標之間的關係發生了質變」,例如後疫情時代的消費行為已和訓練資料所描述的世界截然不同,但模型還在用舊的邏輯做判斷。這種漂移沉默、緩慢,且在被發現之前已經造成了大量錯誤決策。

觀察五:公平性不是道德選擇,是可量化的法律義務

「彼得,公平性這個議題是不是比較軟性?」這是彼得在治理諮詢中最常被問到的問題之一。答案是:完全不。

在受監管的場景中——人才招聘、金融信貸、醫療診斷、刑事司法——AI 的偏見直接對應到歧視法規的法律責任。TEVV 框架對各場景給出了明確的量化閾值,例如招聘場景採用「80% 規則」(不同群體的錄用率差異不能超過 20%)、金融信貸要求不同族群間等化賠率差異低於 20%。

彼得在實務中觀察到一個規律:組織在導入 AI 系統時,往往對模型的技術性能做了詳盡評估,卻沒有對公平性指標做過任何基準測試。等到爭議發生,才發現根本沒有歷史數據可以舉證說明系統是公平的。這是一個典型的「事後難以補救」的治理漏洞。正確的做法是在系統設計之初就決定適用哪種公平性指標,並建立持續的監測機制,讓公平性和準確率一樣成為日常運營的管理指標。

結論:TEVV 是治理語言,不只是技術規格

回顧這五個觀察,彼得認為 AI TEVV 框架最大的貢獻,不在於它提供了哪些具體的技術方法,而在於它創造了一套跨越技術與治理層的共同語言。

「模型魯棒性」、「信心校準」、「概念漂移」、「公平性閾值」——這些詞彙過去只在工程師之間流通。TEVV 把它們轉化為可量化、可稽核、可向董事會報告的治理指標。在金融與醫療等受監管產業,這套框架正在成為 AI 系統獲准上線的必要條件,而非加分選項。

彼得的建議是:不要等監管機構要求才開始部署。從現在就建立這套評估體系,你的組織將在下一輪 AI 治理浪潮中處於主動位置。

本文觀點來自個人心得實務,不代表任何組織或機構立場。

原始文章時間:2026 年 2 月 3 日