一個標準的誕生,代表的不只是驗證證書

2023 年 12 月,ISO/IEC 42001 正式發布,成為全球第一個專為 AI 系統管理設計的國際標準。對許多人來說,這只是「又一個可以拿來掛牌認證的管理系統標準」。但對我來說有不同的看法。

這個標準的出現,代表的是一個訊號:全球監管機構和產業界終於承認,AI 的風險已大到需要系統化管理,而不是靠個別工程師的職業道德自律。

彼得的第一個觀察:它和 ISO 27001 的本質差異

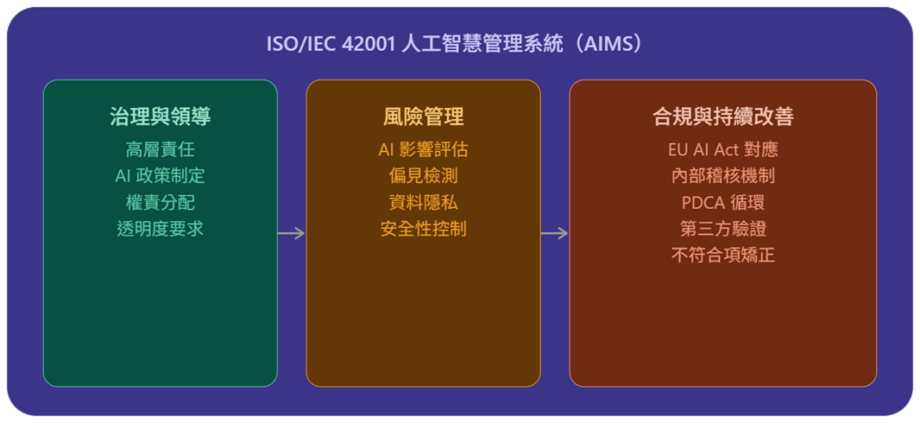

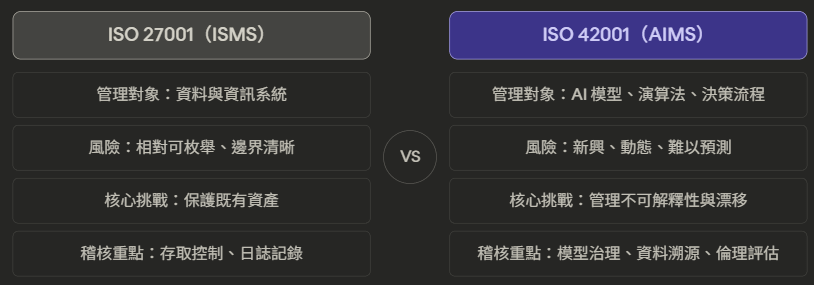

很多客戶第一次接觸 AIMS 時,習慣把它類比成 ISO 27001(資訊安全管理系統)。這個類比有一定道理——兩者都採用高階語言架構(HLS)、都用 PDCA 循環——但危險在於,如果你用導入 27001 的思維來導入 42001,你很可能只做到表面合規,卻完全沒碰到 AI 治理的核心問題。

差異在哪裡?27001 管的是「資料在哪裡、誰能碰、怎麼保護」,這些問題有相對確定的答案。但 42001 管的是 AI 系統,它的核心挑戰是不確定性——AI 模型的決策邏輯往往不透明,訓練資料的偏見可能在部署後才浮現,系統行為會隨資料分布改變而漂移。

這意味著,AIMS 的稽核不能只看文件,必須真正理解組織的 AI 開發與部署流程。

實務觀察:企業最容易踩的三個坑

組織評估 AIMS 導入可行性的過程中,可能會有以下幾個反覆出現的盲點:

第一,把「AI 政策」寫成宣示文件而非操作程序。 標準要求高層領導制定 AI 政策,很多組織確實寫了,但內容往往是「本公司重視 AI 倫理、致力負責任的 AI 應用」這類空話。真正的政策應該定義:什麼樣的 AI 應用需要影響評估?誰有權核准部署高風險 AI?模型性能下降到什麼程度必須觸發複審?

第二,輕忽附錄 A 的 9 大控制目標。 附錄 A 是 AIMS 最有操作難度的部分,涵蓋 AI 系統生命週期各階段的具體控制要求,從資料採集、模型訓練、到部署後監控都有對應的控制點。許多組織在導入時把重心放在條款 4 到 10 的體系之要求,卻忽略了附錄 A 才是真正決定稽核能否通過的關鍵。

第三,沒有建立 AI 系統登錄清單。 你無法管理你不知道的東西。我看過不少組織,各部門自行引入 SaaS AI 工具、使用 API 呼叫外部大型語言模型,但 IT 和資安部門完全不知情。AIMS 要求組織對其使用、開發或提供的 AI 系統有清晰的掌握,這個基礎如果沒有建立,後續所有的風險評估都是空談。

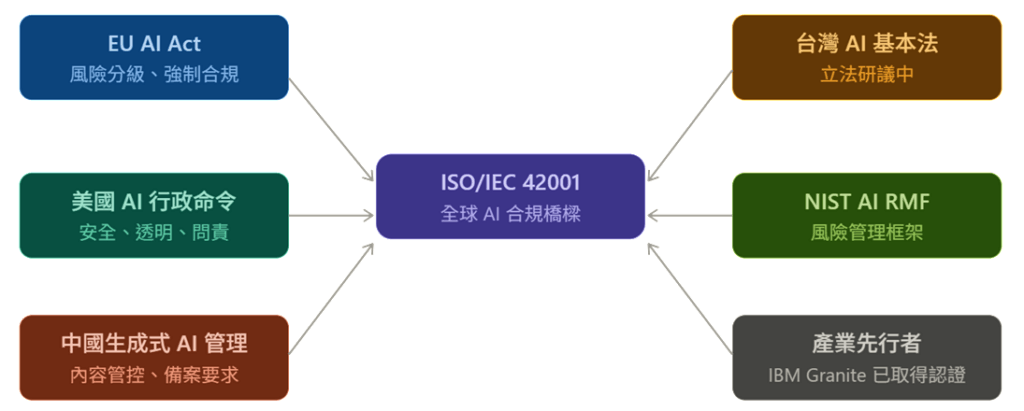

趨勢剖析:AIMS 與全球 AI 監管的交匯點

從全球監管格局來看,AIMS 的戰略價值正在快速升溫。歐盟 AI 法規對高風險 AI 系統設有嚴格的合規要求,而 ISO 42001 認證已被視為向監管機構證明合規能力的有效途徑。值得一提的是,IBM 的 Granite 開源語言模型已於 2025 年取得 ISO 42001 驗證,成為產業標竿——這傳遞了一個清楚的訊號:AI 治理驗證將成為 B2B 採購的基本門檻,而非加分項。

對台灣企業而言,這個時間窗口尤其關鍵。台灣 AI 基本法正在研議之中,現在開始布局 AIMS 的組織,未來將在法規接軌上佔據主動位置。

核心主張:AIMS 不是終點,而是起點

很多組織把取得 ISO 42001 驗證視為目標。我認為這個心態需要調整。

驗證只能證明你在某個時間點的 AI 治理狀態達到了標準的最低要求。但 AI 技術的演進速度遠快於任何管理標準的更新週期。今天通過稽核的控制措施,可能在半年後面對新型態 AI 風險時完全失效。

真正有效的 AI 治理,需要在組織文化層面建立對 AI 風險的持續感知能力——不只是填寫評估表格,而是讓工程師、產品經理、法務、高層主管都能夠用共同的語言討論 AI 的風險與取捨。ISO 42001 提供的 PDCA 框架是一個好的起點,但組織必須在這個框架之上,建立真正屬於自己的 AI 治理文化。

這才是我在與客戶合作時,最終想要幫助他們達到的目標。

本文觀點來自個人心得實務,不代表任何組織或機構立場。

原始文章時間:2024 年 8 月 2 日下午 11:28