「自願」,但不代表「可以不理」

NIST 在 2023 年 1 月發布的 AI 風險管理框架(AI RMF),明確標示「自願使用、非強制性質」。彼得觀察到,每次提到這一點,很多組織就自動把它歸類為「可以之後再說」的參考文件。

這個判斷恐怕要重新想想。

「自願」在 NIST 的語境裡,從來都不意味著「不重要」。NIST CSF 也是自願框架,但現在已成為全球資安治理的事實標準。AI RMF 的設計邏輯完全一樣——它不是法規,但它正在塑造各國監管機構、企業採購標準、保險業核保條件對「AI 治理成熟度」的定義。換句話說,現在自願採用,未來可能就是市場門票。

這個框架在說什麼?先搞清楚架構

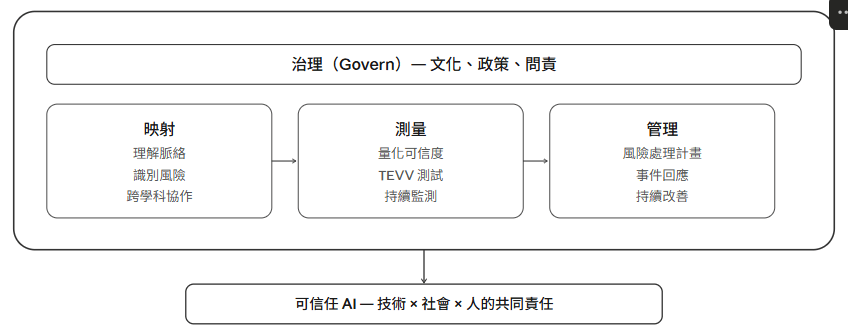

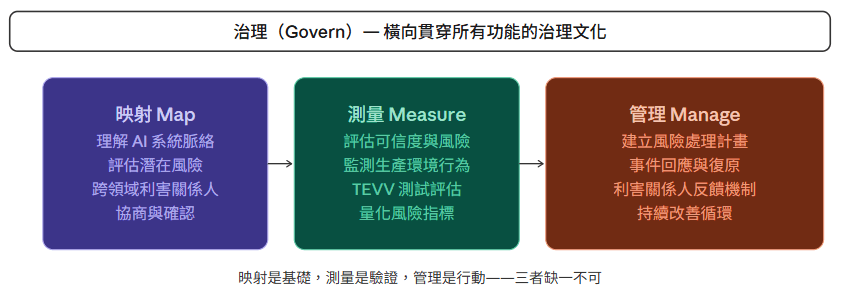

AI RMF 分兩大部分:基礎資訊(Foundational Information)談的是 AI 風險的本質與可信任 AI 的標準;框架核心(Core and Profiles)則是四個功能——治理(Govern)、映射(Map)、測量(Measure)、管理(Manage)。

這四個功能的設計有個聰明之處:「治理」是橫向的,它貫穿其他三個功能,而不是跟它們平行並列。這個設計傳達的訊息很清楚——沒有治理文化支撐的映射、測量、管理,都只是形式。

彼得覺得最值得注意的:AI 的「社會技術性質」

框架在基礎資訊部分特別強調,AI 系統本質上具有「社會技術性質(socio-technical)」——它不只是技術產物,還受社會動態和人類行為的深刻影響。

這個概念說起來容易,落地起來很難。彼得觀察到,很多組織在評估 AI 風險時,習慣只看技術面——模型準確率、資料品質、系統安全性。但 AI 的風險往往在社會層面爆發:一個信貸評分模型即使技術上完美,如果它的訓練資料反映了歷史上的系統性歧視,它就會把這些歧視以「客觀數字」的外衣延續下去。

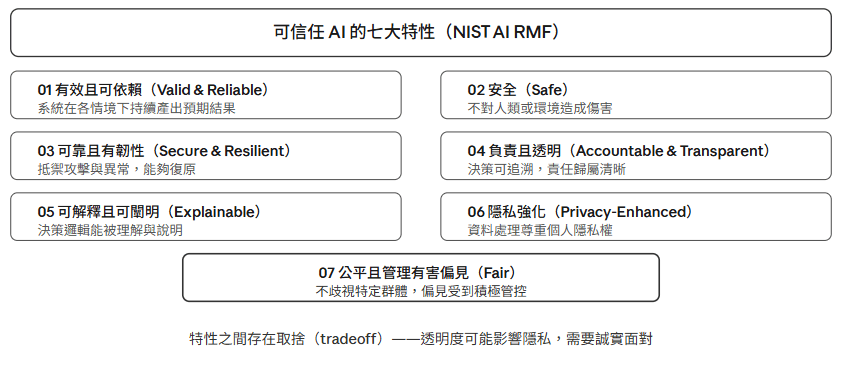

框架列出的七大可信任 AI 特性中,「公平且對有害偏見有所管理」和「負責且透明」排在裡面,但彼得認為它們應該被放在最前面討論——因為這兩點最難量化,也最常被輕忽。

AI actor 的概念:你在哪個位置,就有哪個責任

AI RMF 用「AI actor」這個詞,把所有在 AI 系統生命週期中扮演角色的人都納入責任體系——從系統工程師、資料科學家、終端用戶,一直到受影響的社區和政策制定者。

這個設計傳達了一個重要訊息:AI 風險管理不是哪個部門的事,而是每個人依照自己在生命週期中的位置,承擔相對應的責任。彼得認為這個思維轉變很關鍵——特別是對台灣企業而言,很多組織的 AI 風險意識還停留在「這是 IT 或資料科學部門的事」,與高層、法務、業務團隊完全脫節。

七個可信任 AI 特性:一份對照清單

框架列出的七項可信任 AI 特性,彼得把它視為一個很實用的自我檢查工具。

這七個特性之間存在真實的取捨關係,框架也誠實地承認了這一點。最典型的例子是「可解釋性」與「隱私」之間的張力——解釋越詳細,可能越容易讓人推斷出訓練資料的內容。再比如「公平」與「準確率」之間,在某些場景下確實存在資源分配的取捨。

彼得認為,承認這些取捨的存在,並用透明、合理的方式去應對,才是 AI 治理成熟度的真正體現。否則所謂的「可信任 AI 特性」只會淪為公關材料。

附錄 C 的洞見:人類才是最不穩定的變數

框架在附錄 C 討論「AI 風險管理與人類及 AI 之互動」,彼得覺得這部分是整份文件最有深度的地方,卻也最容易被略過。

核心洞見是:AI 系統的設計和使用,都會反映系統性的人類認知偏見。換句話說,AI 不只是技術問題,更是人的問題。負責設計系統的人帶著偏見,負責解讀輸出的人帶著偏見,受系統影響的人也處在特定的社會脈絡裡。把 AI 當成一個「客觀中立的黑盒子」,是彼得認為企業在 AI 治理上最危險的一個假設。

生成式 AI 工作小組:NIST 的應急反應

框架最後提到,NIST 在 2023 年 6 月成立了生成式 AI 公共工作小組(GAI-PWG),目的是因應生成式 AI 的爆炸性發展。這個新工作小組的存在說明一件事:AI RMF 本身就是一份「活文件」,它意識到自己需要持續更新才能跟上現實。

從趨勢來看,生成式 AI 帶來的風險維度和傳統機器學習完全不同——幻覺(hallucination)、深偽(deepfake)、提示注入(prompt injection)、版權爭議……這些都是 2023 年初發布的框架在設計時還沒有充分考慮的場景。彼得認為,組織在套用 AI RMF 時,必須同時留意 NIST 對生成式 AI 的補充指引,不能只停留在 1.0 版本的思維框架裡。

彼得對這份框架的整體評價是:它是目前市面上對 AI 風險思考最系統、最誠實的公開文件之一。它不假裝 AI 風險可以被完全解決,它也不假裝框架本身已經完美。這種誠實,反而讓它更有實用價值。

本文觀點來自個人心得與觀察,不代表任何組織或機構立場。

原始文章時間:2024 年 7 月 21 日