評估不是表格,是一種思維框架

近年來,「AI 影響評估」這個詞在治理圈裡愈來愈常被提及。但彼得觀察到一個令人憂慮的現象:許多組織把影響評估當成一份需要填寫的表格,填完歸檔,任務完成。這種心態,正是最危險的治理盲點。

真正的 AI 系統影響評估(AI System Impact Assessment),是一套系統化的過程——識別、分析、並主動因應 AI 技術對個人、群體與社會結構可能帶來的衝擊。它的價值不在於文件本身,而在於驅動組織在每一個 AI 部署決策前,認真問一個問題:「這個系統,對誰可能造成什麼影響?」

彼得的觀察一:「利害關係人」被嚴重低估了

從趨勢來看,多數組織在 AI 系統上線前,只思考兩類人:開發團隊與直接使用者。但彼得認為,這個視野遠遠不夠。

真正完整的利害關係人圖譜,應該涵蓋最終用戶、邊緣化社群、監管機構、產業代表,乃至於那些從未主動接觸 AI 系統、卻因其決策而受到影響的一般大眾。一個用於信貸審核的 AI,影響的不只是申請人,還包括被演算法系統性忽視的特定族群;一個用於招聘篩選的 AI,影響的不只是求職者,還重塑了整個勞動市場的機會分配。

把這些隱形利害關係人納入評估,不僅是倫理要求,也是風險管理的必要動作——因為被忽視的群體,往往是法律訴訟和社會輿論反彈的源頭。

彼得的觀察二:演算法偏差是歷史不公的鏡像

演算法偏差(Algorithmic Bias)的問題,在過去幾年已有不少討論,但彼得觀察到,產業界對這個問題的理解仍然停留在表面。

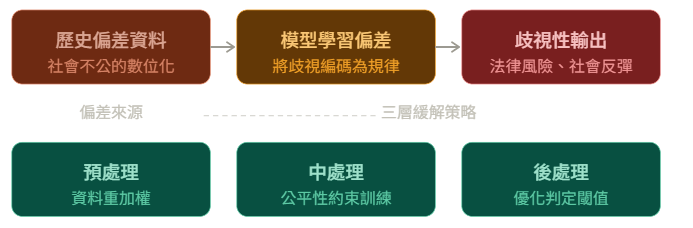

偏差不是技術錯誤,而是社會結構的投影。當訓練資料本身就來自一個存在歧視的歷史背景,模型學到的「規律」就會把這些歧視編碼進去,然後以看似客觀的數據形式輸出。臉部辨識演算法對特定族裔的辨識準確率偏低、推薦系統根據性別強化職業刻板印象——這些都不是偶然的技術瑕疵,而是系統性問題的症狀。

從治理趨勢來看,單純的「多元化訓練資料」並不足以解決問題。真正需要的是在評估框架中建立持續的偏差偵測機制,讓偏差的識別成為常態營運流程,而非只在爭議發生後才啟動的事後補救。

彼得的觀察三:資料隱私評估不能只看技術層面

GDPR 施行以來,許多組織把資料隱私合規理解為「加密、存取控制、外洩通報」這三件事。彼得的看法是,這種理解對 AI 系統而言已經嚴重不足。

AI 系統的隱私風險有其獨特性:模型本身就可能成為資料外洩的管道。透過對模型輸出的系統性探測,攻擊者可以推斷訓練集中是否包含特定個人的資料,甚至還原出部分敏感資訊——這就是所謂的模型逆向攻擊(Model Inversion Attack)與成員推理攻擊(Membership Inference Attack)。

從監管趨勢來看,歐盟 AI 法規正在把隱私保護的範疇從「資料處理合規」擴展到「模型設計合規」,要求組織從設計初期就把隱私保護內建進 AI 系統,而非事後補貼。這個趨勢對台灣企業而言尤其值得關注——隨著台灣個資法與國際接軌的壓力增加,現在就建立「隱私設計(Privacy by Design)」的 AI 開發文化,將是未來合規的關鍵前提。

彼得的觀察四:社會福祉分析是 AI 治理的下一個主戰場

彼得認為,在未來五年內,「AI 對社會就業與經濟結構的影響」將成為全球 AI 治理最核心、也最具爭議的議題。

目前的討論還停留在「AI 會不會取代工作」這個層次。但真正複雜的問題是:即便 AI 創造了新工作,這些新機會的分配是否公平?是否進一步拉大了數位落差?資源的優化是否只惠及了本已具備優勢的族群?

這些問題沒有簡單答案,但 AI 影響評估框架提供了一個方法論起點:把社會福祉分析系統化、數據化,讓政策制定者和組織能夠在做決策時,把「對社會凝聚力的影響」和「對財務表現的影響」放在同一張桌上討論。這是彼得認為未來十年 AI 治理最需要突破的能力邊界。

彼得的觀察五:持續監控才是影響評估的靈魂

一份在系統上線前完成的影響評估報告,有效期限是多長?彼得的答案是:不確定,但肯定比大多數組織預期的要短得多。

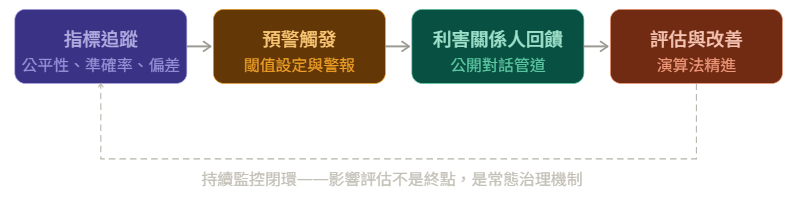

AI 系統在部署後會持續演化——使用者行為改變、資料分布漂移、社會脈絡轉變,都可能讓原本通過評估的系統在幾個月後產生完全不同的影響。這意味著影響評估不能是一次性活動,而必須成為持續的治理機制。

從趨勢來看,愈來愈多的監管框架開始要求「部署後監控報告」,而不只是「上線前評估報告」。彼得認為,組織需要建立的是一套把影響評估嵌入日常 AI 運營的制度設計——定期追蹤關鍵指標、建立預警機制、形成利害關係人回饋管道,讓評估真正成為一個活的治理工具,而非歸檔後束之高閣的靜態文件。

從文件到文化:彼得的核心看法

AI 系統影響評估的框架本身並不複雜,ISO 42001 也提供了清晰的結構性指引。但彼得認為,框架只是起點。真正決定評估有效性的,是組織內部是否形成了一種文化——讓「這個 AI 系統對誰會造成什麼影響」成為每一次部署決策的標準問題,而不是例外性的審查程序。

從全球趨勢來看,監管壓力只會增加,社會對 AI 透明度與問責制的期待也只會提高。現在選擇認真對待影響評估的組織,正在為自己建立一個長期的信任資產。而那些選擇把評估當成形式的組織,遲早會在市場或法律層面付出代價。

這是彼得對 AI 治理未來最篤定的一個判斷。

本文觀點來自個人心得實務,不代表任何組織或機構立場。

原始文章時間:2024年 6月 16 日